Günümüz iş dünyasında yapay zekâ projeleri, şirketlerin rekabet avantajı elde etmesinde kritik bir rol oynuyor. Ancak bir yapay zekâ projesinin başarısı, büyük ölçüde kullanılan verilerin kalitesine ve bu verilerin nasıl yönetildiğine bağlı. Veri bilimciler, proje zamanlarının önemli bir bölümünü veri hazırlığına harcıyor. Bu durum, yapay zekâ projeleri için veri yönetiminin ne kadar kritik olduğunu açıkça gösteriyor. Kurumlar, sahip oldukları veri varlıklarını etkin bir şekilde yönetemediklerinde, yapay zekâ yatırımlarından bekledikleri getiriyi elde edemiyor. İşte tam bu noktada yapay zekâ projeleri için veri yönetimi rehberi, kurumların bu zorlu yolculukta ellerini güçlendiren bir kaynak olarak öne çıkıyor.

Yapay Zekâ ve Veri İlişkisi

Yapay zekâ modelleri, tıpkı bir insanın öğrenme süreci gibi, verilerden beslenir. Bir çocuk nasıl etrafındaki nesneleri gözlemleyerek öğreniyorsa, yapay zekâ modelleri de veriler üzerinde yapılan eğitimlerle gelişir. Ne kadar çok ve kaliteli veri sunulursa, modelin başarımı o kadar artar. Bu nedenle veri yönetimi, yapay zekâ projelerinin olmazsa olmaz bir parçası haline geliyor. Yapay zeka veri yönetimi süreçleri, projenin her aşamasında dikkatle ele alınmalıdır.

Yapay Zeka Veri Toplama: Nedir ve Nasıl Çalışır?

Yapay zeka teknolojileri günümüzde iş dünyasının temel unsurlarından biri haline gelmiş durumda. Sohbet botları, dijital yardımcılar ve metin, görüntü ile sesi aynı anda işleyebilen çok modlu sistemler gibi pek çok uygulama yapay zeka altyapıları üzerine kuruluyor. McKinsey tarafından yayımlanan araştırmalar da bu dönüşümü açık biçimde ortaya koyuyor; verilere göre kurumların yaklaşık %88’i en az bir iş sürecinde yapay zeka çözümlerinden yararlanıyor. Pazarın büyüme hızı da dikkat çekici seviyede. 2025 yılında yaklaşık 390,9 milyar dolar büyüklüğe ulaşması beklenen yapay zeka pazarının, 2033 yılına gelindiğinde 3,5 trilyon dolarlık bir hacme ulaşacağı öngörülüyor.

Bu hızlı gelişimin merkezinde ise güçlü bir unsur bulunuyor: yüksek kaliteli veri. Başarılı yapay zeka sistemleri, doğru ve güvenilir veri setleriyle eğitildiklerinde gerçek değer üretir. Bu rehber, yapay zeka projeleri için uygun verilerin nasıl elde edileceğini, veri kalitesi ve uyumluluğunun nasıl güvence altına alınacağını ve farklı ihtiyaçlara göre en doğru veri yaklaşımının nasıl seçileceğini kapsamlı şekilde ele alıyor.

Yapay Zeka Veri Toplama Nedir?

Yapay zeka veri toplama, model eğitimi ve değerlendirme süreçlerinde kullanılacak veri setlerinin hazırlanmasını kapsayan kapsamlı bir çalışmadır. Bu süreç; doğru veri kaynaklarının belirlenmesini, verilerin temizlenip yapılandırılmasını, gerekli meta verilerin eklenmesini ve ihtiyaç duyulduğunda etiketlenmesini içerir. Ancak veri toplama yalnızca veriyi elde etmekten ibaret değildir. Asıl amaç, verinin gerçek dünya kullanımına uygun, güvenilir, yeterince çeşitli ve gerektiğinde denetlenebilecek şekilde açık biçimde belgelenmiş olmasını sağlamaktır.

Yapay Zeka Projelerinde En Yaygın Veri Formatları

Yapay zeka veri kümeleri, geliştirilen sisteme bağlı olarak dört ana kategoriye ayrılır:

| Veri Formatı | Açıklama | Kullanım Alanları | Örnekler |

|---|---|---|---|

| Metin Verileri | Yapılandırılmış veya yapılandırılmamış metin içeriği | Dil modelleri, sohbet botları, metin analizi | Tablolar, CRM kayıtları, e-postalar, sohbet kayıtları, belgeler |

| Ses Verileri | Konuşma ve ses kayıtları | Sesli asistanlar, çağrı analizi, konuşma tanıma | Çağrı merkezi kayıtları, sesli komutlar, çok dilli konuşma örnekleri |

| Görüntü Verileri | Dijital görüntüler | Nesne tespiti, tıbbi görüntü analizi, ürün tanıma | Etiketli görüntüler, sınırlayıcı kutular, segmentasyon maskeleri |

| Video Verileri | Zaman içinde ardışık görüntüler | Otonom sürüş, gözetim analizi, spor analizi | Kare kare etiketleme, olay etiketlemesi, hareket analizi |

2026’da yapay zeka veri toplama yöntemleri, birçok sistemin yapay zeka tarafından desteklenmesi nedeniyle farklı bir görünüm kazanacak. Ekipler paralel olarak üç tür veri topluyor:

- Öğrenme verileri: Davranışı öğretmek için

- Temellendirme verileri: Doğru cevaplar için hazır belgeler

- Değerlendirme verileri: Geri çağırma doğruluğunu, yanılsamaları ve politika uyumunu ölçmek için

Yapay Zeka Veri Toplama Yöntemleri

| Yöntem | Açıklama | En Uygun Olduğu Durumlar | Örnek |

|---|---|---|---|

| Birinci Taraf Veri Toplama | Kendi ürün, kullanıcı ve operasyonlardan toplanan veriler | Gerçek davranışı yansıtan en değerli veriler | Destek talepleri, arama kayıtları, sohbet botu görüşmeleri |

| Manuel/Uzman Rehberliğinde Toplama | Uzmanlar tarafından kasıtlı veri toplama | Derin bağlam, alan bilgisi, yüksek doğruluk gerektiğinde | Sağlık uzmanlarının tıbbi raporları etiketlemesi |

| Kitlesel Kaynak Kullanımı | Geniş çalışan havuzundan veri toplama | Hızlı ve büyük ölçekli veri ihtiyacı | Ses kliplerinin yazıya dökülmesi |

| Web Veri Toplama | Kamuya açık web sitelerinden otomatik bilgi çıkarma | Büyük ölçekli kamu verisi ihtiyacı | Ürün özelliklerinin toplanması |

| API Tabanlı Veri Toplama | Resmi API’ler aracılığıyla veri çekme | Tutarlı, güvenilir veri gerektiğinde | Finansal piyasa verileri |

| Sensör ve IoT Veri Toplama | Cihaz ve sensörlerden sürekli veri akışı | Gerçek zamanlı karar gerektiren durumlar | Fabrika makinelerinden titreşim verileri |

| Üçüncü Taraf Veri Kümeleri | Satıcılardan hazır veri seti satın alma | Geliştirmeyi hızlandırma, kapsama boşluklarını doldurma | Çok dilli konuşma veri setleri |

| Sentetik Veri Üretimi | Yapay veri oluşturma | Gizlilik kısıtlamaları, nadir olaylar, sınıf dengesizliği | Nadir dolandırıcılık işlem modelleri |

Veri Kalitesi Yapay Zeka Başarısını Neden Belirler?

Yapay zeka sektörü önemli bir dönüşüm noktasına ulaşmış durumda. Temel model mimarileri giderek birbirine benzer hale gelirken, sistemler arasındaki asıl farkı yaratan unsur veri kalitesi oluyor. Yüksek kaliteli veriyle eğitilen modeller kullanıcı beklentilerini karşılayan başarılı ürünler ortaya çıkarırken, düşük kaliteli veri kullanan sistemler ise çoğu zaman kullanıcı deneyiminde hayal kırıklığına yol açabiliyor.

Kötü Eğitim Verilerinin Maliyeti

| Sorun | Etkisi |

|---|---|

| Model hataları | Halüsinasyonlar, gerçek dışı bilgiler, ton tutarsızlıkları |

| Uyumluluk maruziyeti | İzinsiz veri kullanımından kaynaklanan yasal sorumluluk |

| Yeniden eğitim maliyetleri | Dağıtım sonrası keşfedilen sorunlar için pahalı yeniden eğitim döngüleri |

Kurumsal ekipler, makine öğrenimi projelerinin zamanının %40-60’ını veri hazırlığı ve düzeltme işlemlerine harcıyor.

Aranması Gereken Kalite Sinyalleri

- Demografik ve dilsel çeşitlilik: Veriler gerçek kullanıcı tabanınızı temsil ediyor mu?

- Açıklama derinliği: Ek açıklamalar nüansları yakalıyor mu?

- Etiket tutarlılığı: Aynı öğe iki kez incelendiğinde etiketler tutarlı kalıyor mu?

- Sınır durumlarının kapsamı: Nadir ama önemli senaryolar dahil edilmiş mi?

- Zamansal önem: Veriler alanınız için yeterince güncel mi?

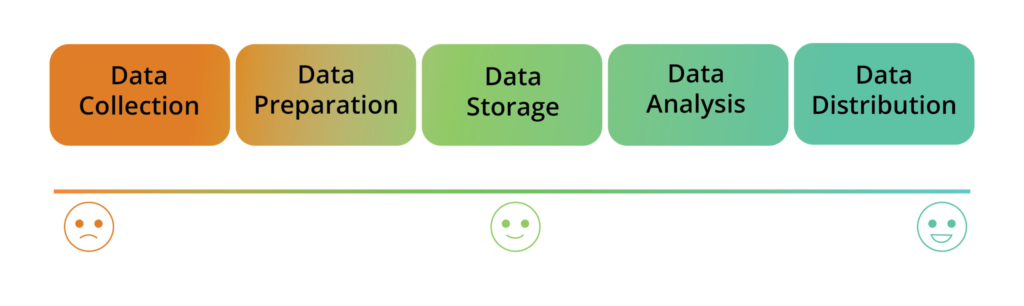

Veri Toplama Süreci: Adım Adım

Ölçeklenebilir bir yapay zeka veri toplama süreci; tekrarlanabilir, ölçülebilir ve düzenleyici gerekliliklerle uyumlu bir yapıya sahip olmalıdır. Bu yaklaşım, veri toplama ve hazırlama adımlarının standartlaştırılmasını sağlayarak süreçlerin zaman içinde sürdürülebilir biçimde yürütülmesine yardımcı olur. Çoğu yapay zeka girişimi için temel amaç ise ekiplerin ilerleyen dönemlerde güvenle yeniden kullanabileceği, denetlenebilir ve sürekli geliştirilebilir, makine tarafından işlenmeye hazır veri setleri oluşturmaktır.

✅Adım 1: Kullanım Senaryosunu ve Başarı Ölçütlerini Tanımlayın

Verilere değil, iş sorununa odaklanın:

- Bu model hangi sorunu çözüyor?

- Üretimde başarı nasıl ölçülecek?

Örnek hedefler:

- “Destek taleplerindeki artışı 6 ay içinde %15 oranında azaltın.”

- “En sık kullanılan 50 self-servis sorgusu için arama doğruluğunu iyileştirin.”

- “Üretimde kusur tespitine yönelik geri çağırma oranını %10 artırın.”

✅Adım 2: Veri Gereksinimlerini Belirtin

Kullanım senaryosunu somut veri özelliklerine dönüştürün:

- Veri tipleri: metin, ses, görüntü, video, tablo veya karışımı

- Ses seviyesi aralıkları: pilot uygulama ve tam ölçekli uygulama arasındaki fark

- Diller ve yerel ayarlar: çok dilli, aksanlar, lehçeler, bölgesel formatlar

- Ortamlar: sessiz, gürültülü, klinik, tüketici, fabrika, ofis

- Sınır durumlar: nadir ama yüksek etkili senaryolar

✅Adım 3: Veri Toplama Yöntemlerini ve Kaynaklarını Seçin

Ekipler genellikle üç ana kaynağı birleştirir:

| Kaynak | Avantaj | Dezavantaj |

|---|---|---|

| Ücretsiz/Herkese Açık Veri Kümeleri | Deneyler için kullanışlı | Alanla uyumsuz olabilir, lisanslama sorunları |

| Dahili Veriler | Son derece değerli | Ham, yetersiz, hassas olabilir |

| Ücretli/Lisanslı Veri Sağlayıcıları | Yüksek kaliteli, uyumlu, ölçeklenebilir | Maliyetli |

✅Adım 4: Verileri Toplayın ve Standartlaştırın

Veri akışı başladığında, standardizasyon daha sonraki karışıklığı önler:

- Tutarlı dosya formatları kullanın

- Zengin meta verileri yakalayın: tarih/saat, yerel ayar, cihaz, kanal, ortam, onay durumu, kaynak

- Şema ve ontoloji konusunda uyum sağlayın

✅Adım 5: Temizleyin ve Filtreleyin

Ham veriler karmaşıktır. Temizleme işlemi, yalnızca yararlı verilerin ilerlemesini sağlar:

- Yinelenen ve neredeyse aynı kayıtları kaldırma

- Bozuk, düşük kaliteli veya eksik örnekleri eleme

- Kapsam dışı içerikleri filtreleme

- Biçimleri normalleştirme

✅Adım 6: Etiketleme ve Açıklama Ekleme

Denetimli sistemler, tutarlı ve yüksek kaliteli etiketlere ihtiyaç duyar:

- Sohbet botları için amaçlar ve varlıklar

- Konuşma analizi için transkriptler ve konuşmacı etiketleri

- Bilgisayar görüşü için sınırlayıcı kutular, segmentasyon maskeleri

- Arama sistemleri için alaka düzeyi değerlendirmeleri

- Sağlık alanında doğal dil işleme için klinik kavramlar

✅Adım 7: Gizlilik, Güvenlik ve Uyumluluk Kontrolleri

Veri toplama, ilk günden itibaren yasal ve etik sınırlara uygun olmalıdır:

- Kişisel verilerin anonimleştirilmesi

- Onay takibi ve veri kullanım kısıtlamaları

- Saklama ve silme politikaları

- Rol tabanlı erişim kontrolleri

- GDPR, HIPAA, CCPA uyumluluğu

✅Adım 8: Kalite Güvencesi ve Kabul Testi

Bir veri kümesi “model için hazır” ilan edilmeden önce yapılandırılmış kalite kontrolünden geçmelidir:

- Örnekleme ve denetimler

- Altın setler (uzmanlar tarafından etiketlenmiş referans seti)

- Hata takibi ve sınıflandırma

- Kabul kriterleri için önceden tanımlanmış eşikler

✅Adım 9: Paketleme, Belgeleme ve Sürüm Oluşturma

Verilerin bugün kullanılabilir ve yarın yeniden üretilebilir olması gerekir:

- Net şemalar, etiket taksonomileri ve meta veri tanımları

- Kaynaklar, yöntemler, bilinen sınırlamalar hakkında belgeler

- Sürüm veri kümeleri

- Dahili keşfedilebilirlik

Kurum İçi mi, Dış Kaynak Kullanımı mı, Yoksa Hibrit Model mi?

| Model | Açıklama | En İyisi Ne Zaman | Dezavantaj |

|---|---|---|---|

| Kurum İçi | Ekibiniz tüm süreci yürütür | Veriler son derece hassas, iş akışları benzersiz, güçlü iç operasyonlar var | Personel alımı zaman alır, ölçeklendirme zordur |

| Dış Kaynak Kullanımı | Tedarikçi tüm süreci yönetir | Hız, küresel ölçek, çok dilli kapsama alanı gerektiğinde | Güçlü tedarikçi yönetimi gerektirir |

| Hibrit Model | Strateji şirket içinde, uygulama dış kaynakta | Kontrol ve hız isteniyor, sık yenileme gerekiyor | Net geçişler ve kabul kriterleri gerektirir |

Hibrit model, LLM ve RAG programları için en yaygın kurumsal kurulumdur.

Veri Toplama Zorlukları

| Zorluk | Açıklama |

|---|---|

| Alaka boşlukları | Veriler mevcut ancak gerçek kullanım senaryosuyla uyuşmuyor |

| Kapsam boşlukları | Eksik diller, aksanlar, demografik bilgiler, cihazlar, ortamlar |

| Önyargı | Veri seti belirli grupları aşırı temsil ediyor |

| Gizlilik ve onay riski | Hassas bilgiler içerebilir |

| Menşei ve lisanslama belirsizliği | Yasal olarak yeniden kullanılamayacak veriler |

| Ölçek ve zaman baskısı | Hacim arttıkça kalite düşüyor |

| Eksik geri bildirim döngüsü | Veri seti gerçeklikle örtüşmeyi bırakıyor |

Veri Toplamanın Faydaları

Doğru yapıldığında, veri toplama süreci şu faydaları sağlar:

| Fayda | Açıklama |

|---|---|

| Daha yüksek model güvenilirliği | Üretimde daha az sürpriz, daha iyi genelleme |

| Daha hızlı yineleme döngüleri | Temizleme ve yeniden etiketlemede daha az tekrarlama |

| Daha güvenilir LLM uygulamaları | Daha iyi temellendirme, daha az halüsinasyon |

| Düşük uzun vadeli maliyet | Erken aşamada kalite, sonradan pahalı düzeltmeleri önler |

| Daha iyi uyumluluk duruşu | Net dokümantasyon, denetim kayıtları, kontrollü erişim |

ITSTACK Farkı

ITSTACK, veri toplama süreçlerindeki karmaşıklığı ortadan kaldırarak ekiplerin doğrudan model geliştirme ve inovasyona odaklanmasını sağlar. Geniş küresel ağımız sayesinde farklı veri türlerinden oluşan kapsamlı veri setleri sunuyoruz. Metin, ses, görüntü ve video gibi verileri hızlı biçimde topluyor; ardından temizleme, etiketleme ve kalite kontrol süreçlerinden geçirerek yapay zeka projelerinde kullanılmaya hazır hale getiriyoruz.

💡Neden ITSTACK?

- Pilot uygulama ile ölçeklendirmeden önce sonuçları kanıtlama

- Küresel çeşitlilik ve dengeli temsil

- GDPR, HIPAA, CCPA uyumluluğu

- Pilot uygulamadan seri üretime sorunsuz geçiş

Yapay zeka modelleriniz için en yüksek kaliteli veri kümelerine ihtiyaç duyduğunuzda ITSTACK olarak yanınızdayız. Veri toplama sürecinin tüm zorluklarını ortadan kaldırıyor, sizin yalnızca model inovasyonuna odaklanmanızı sağlıyoruz.

Yapay Zekada Veri Kalitesi Nedir?

Yapay zeka bağlamında veri kalitesi, bir veri kümesinin yapay zeka uygulamasının belirli ihtiyaç ve gereksinimlerini ne ölçüde karşıladığını ifade eder. Veri kalitesi, verilerin doğruluğu, bütünlüğü, tutarlılığı ve güncelliği gibi özellikleri kapsar. Yapay zeka modelleri beslendikleri verilerden öğrendiği için veri kalitesi hayati önem taşır. Veri hatalıysa, model hatalı örüntüler öğrenir ve hatalı tahminler üretir. Forbes Advisor Araştırması’na göre işletmelerin %64’ü yapay zekanın üretkenliği artıracağına inanıyor, ancak bu büyük ölçüde kullanılan verinin kalitesine bağlı.

Yapay Zekada Veri Kalitesinin Önemi

Yapay zeka için veri, kuruluşların yapay zeka algoritmalarını ve karar alma süreçlerini besleyen yakıt niteliğindedir. Yüksek kaliteli veri, doğru ve güvenilir yapay zeka modellerinin temelini oluşturur ve işletmelerin değerli veri içgörüleri elde etmesini ve bilinçli kararlar almasını sağlar.

- Doğru Veri Etkili Yapay Zekayı Besler: Yapay zeka algoritmalarının performansı büyük ölçüde eğitildikleri verinin kalitesine bağlıdır. Yüksek kaliteli veri setleri, modellerin örüntüleri daha doğru şekilde tanımasına, güvenilir tahminler üretmesine ve anlamlı içgörüler sunmasına yardımcı olur. Buna karşılık hatalı veya tutarsız veriler, yapay zeka sistemlerinin yanlış sonuçlar üretmesine, kaynakların verimsiz kullanılmasına ve potansiyel fırsatların kaçırılmasına neden olabilir.

- Daha İyi Kararlar Daha İyi Sonuçlar Getirir: Veri, kurumların bilinçli ve stratejik kararlar alabilmesi için temel bir kaynaktır. Veri kalitesinin sağlanması, işletmelerin büyümeyi destekleyen, operasyonel verimliliği artıran ve müşteri memnuniyetini güçlendiren kararlar almasını mümkün kılar. Düşük kaliteli veriler ise yanlış analizlere, maliyetli hatalara ve kurumsal güvenilirliğin zedelenmesine yol açabilir.

- Veri Bütünlüğü Kritik Bir Unsurdur: Veri bütünlüğü, verilerin zaman içinde güvenilirliğini ve sürdürülebilirliğini korumasını ifade eder. Verilerin yaşam döngüsü boyunca doğruluğunun, tutarlılığının ve eksiksizliğinin korunması; etkili veri yönetişimi ve yüksek veri kalitesi için temel bir gerekliliktir. Bu yaklaşım, kurumların veri analizlerine güvenmesini ve elde edilen sonuçlara dayanarak daha sağlam kararlar almasını sağlar.

Kuruluşunuzun verilerinin yalnızca bol miktarda değil, aynı zamanda doğru, tutarlı ve eksiksiz olmasını sağlamak için veri kalitesi ve bütünlüğünü garanti altına alacak bir dizi uygulama ve politika hayata geçirmeniz gerekir.

Yapay Zekada Kaliteli Verinin Temel Bileşenleri Nelerdir?

Yapay zekada kaliteli verinin temel bileşenleri doğruluk, tutarlılık, bütünlük, güncellik ve uygunluktur. Bu bileşenler, doğru ve güvenilir yapay zeka modelleri oluşturmak için vazgeçilmezdir.

- Doğruluk: Veri kalitesinin en kritik unsurlarından biridir. Yapay zeka modellerini eğitmek için kullanılan verilerin hatalardan ve tutarsızlıklardan arındırılmış olması gerekir. Yanlış veya hatalı veriler, modelin hatalı tahminler yapmasına ve yanlış kararlar üretmesine neden olabilir. Örneğin yanlış müşteri bilgilerinin yer aldığı bir veri kümesi, bir sohbet robotunun kullanıcıya yanıltıcı veya işe yaramayan yanıtlar vermesine yol açabilir. Bu nedenle kurumların veri doğrulama süreçlerini titizlikle yürütmesi ve veri setlerini düzenli olarak kontrol etmesi büyük önem taşır.

- Bütünlük: Veri kümesinin gerekli tüm bilgi ve içgörüleri kapsaması anlamına gelir. Eksik veya tamamlanmamış veriler, yapay zeka modelinin sağlıklı sonuçlar üretmesini zorlaştırabilir ve taraflı analizlere yol açabilir. Bu nedenle kurumların, ele alınan problemi tüm yönleriyle temsil eden kapsamlı veri setleri oluşturması gerekir. Birden fazla kaynaktan veri toplamak veya eksik veri noktalarını tamamlamak, veri bütünlüğünü güçlendirmeye yardımcı olabilir.

- Tutarlılık: Verilerin tekdüze ve uyumlu bir formatta bulunmasını ifade eder. Farklı formatlarda veya standartlarda tutulan veriler, yapay zeka modellerinin verileri analiz etmesini ve anlamlı ilişkiler kurmasını zorlaştırabilir. Örneğin bir veri setinde müşteri bilgilerinin farklı formatlarda tutulması, modelin verileri doğru şekilde işlemesini engelleyebilir. Bu nedenle veri yönetimi süreçlerinde ortak standartlar ve veri yönetişim kuralları belirlemek önemlidir.

- Güncellik: Verilerin zaman açısından güncel ve geçerli olması anlamına gelir. Özellikle gerçek zamanlı analiz gerektiren uygulamalarda güncelliğini yitirmiş veriler, yapay zeka modellerinin yanlış sonuçlar üretmesine neden olabilir. Örneğin eski işlem verilerine dayanan bir dolandırıcılık tespit sistemi, yeni dolandırıcılık yöntemlerini tespit etmekte yetersiz kalabilir. Bu nedenle kurumların düzenli veri güncelleme süreçleri oluşturması ve veri akışını sürekli olarak yenilemesi gerekir.

- Uygunluk: Verilerin, geliştirilen yapay zeka modeli ve çözülmek istenen problemle doğrudan ilgili olmasıdır. Alakasız veya gereksiz veriler modelin öğrenme sürecini zorlaştırabilir ve performansını düşürebilir. Bu nedenle veri seçim sürecinde dikkatli davranmak, gerekli verileri belirlemek ve ham veriden anlamlı özellikler çıkararak modele uygun hale getirmek önemlidir. Kurumların yapay zeka projelerinin kapsamını net şekilde belirlemesi ve hedefleriyle uyumlu veri toplaması bu noktada kritik rol oynar.

Bu beş bileşene ek olarak, verilerin organizasyonu da önemlidir. Veriler, anlaşılması ve kullanılması kolay bir şekilde iyi organize edilmelidir. Bu, çeşitli veri yönetimi teknikleriyle yapılabilir.

Yapay Zekada Veri Kalitesini Sağlamanın Zorlukları Nelerdir?

Yapay zekada veri kalitesini sağlamanın bazı temel zorlukları şunlardır:

- Veri toplama: Yapay zeka projelerinde karşılaşılan ilk zorluklardan biridir. Modelin doğru sonuçlar üretebilmesi için kullanılan verilerin ilgili, temsili ve mümkün olduğunca tarafsız olması gerekir. Ancak bu tür veri setlerini oluşturmak çoğu zaman zaman alıcı ve maliyetli bir süreçtir. Özellikle önyargıyı azaltmak amacıyla farklı kullanıcı gruplarından veri toplamak oldukça zor olabilir. Bunun yanında veri gizliliği düzenlemeleri ve etik kurallar da bazı veri türlerinin kullanımını sınırlayarak veri erişimini zorlaştırabilir.

- Veri etiketleme: Yapay zeka modellerinin eğitilmesi için verilerin doğru ve tutarlı biçimde etiketlenmesi gerekir. Ancak manuel etiketleme süreçleri hem yoğun emek gerektirir hem de insan hatalarına açıktır. Otomatik etiketleme yöntemleri bu süreci hızlandırabilir; ancak bu sistemlerin de doğru çalışabilmesi için önceden yüksek kaliteli etiketli veri setlerine ihtiyaç duyulması yeni zorluklar ortaya çıkarabilir.

- Veri depolama ve güvenliği: Yapay zeka projeleri büyük miktarda veri üretir ve işler. Bu nedenle kuruluşların verilerin erişilebilirliğini ve bütünlüğünü koruyacak güçlü depolama altyapılarına yatırım yapması gerekir. Aynı zamanda hassas verilerin yetkisiz erişim, veri ihlalleri ve kötüye kullanım risklerine karşı korunması büyük önem taşır. Özellikle sağlık, finans ve kamu gibi sektörlerde veri güvenliği kritik bir konu haline gelir.

- Veri yönetişimi: Veri kalitesinin tüm yaşam döngüsü boyunca korunmasını sağlayan önemli bir süreçtir. Veri toplama, depolama, kullanım ve paylaşım aşamalarını kapsayan net politika ve prosedürlerin belirlenmesi gerekir. Ancak farklı veri kaynakları, ekipler ve paydaşların bulunduğu büyük organizasyonlarda etkili bir veri yönetişimi modeli oluşturmak ve uygulamak oldukça karmaşık bir süreç olabilir.

Veri kalitesini sağlamak, dikkatli planlama ve uygulama gerektiren karmaşık bir iştir. Bu zorlukların üstesinden gelmek için veri toplama, etiketleme ve depolama konularında gelişmiş teknikler kullanılmalıdır.

Yapay Zekada Veri Kalitesini Sağlamak İçin En İyi Uygulamalar

Yapay zeka uygulamaları için yüksek kaliteli veri sağlamak amacıyla en iyi uygulamaları hayata geçirmek önemlidir. İşte yapay zekada veri kalitesini sağlamak için beş temel en iyi uygulama:

1. Veri Yönetişim Politikaları Uygulayın

Veri yönetişimi, kuruluş genelinde verileri yönetmek, işlemek ve korumak için kurallar ve sorumluluklar belirlemeyi içerir. Bu, veri sahipliğini tanımlamayı, düzenleyici standartlara uygunluğu sağlamayı ve veri kalitesi prosedürlerini uygulamayı kapsar. Bir araştırmaya göre, kaynak sektöründeki katılımcıların %93’ü yapay zeka için veri yönetişimi önlemleri uygulamış durumda.

İzlenecek adımlar:

- Net politikalar oluşturun: Veri toplama, depolama, kullanım ve paylaşım için politikalar uygulayın.

- Veri kaynağını izleyin: Verilerin kökenini ve dönüşümlerini anlamak için geçmişini takip edin.

- Veri kaynaklarını ve süreçlerini belgeleyin: Verilerin nereden geldiği ve nasıl işlendiğine dair ayrıntılı kayıtlar tutun.

2. Veri Kalitesi Araçlarından Yararlanın

Veri doğrulama, temizleme ve dönüştürme süreçlerini otomatikleştirmek için veri kalitesi araçlarını kullanın. Bu araçlar tutarsızlıkları, eksik değerleri, kopyaları ve aykırı değerleri tespit etmeye yardımcı olarak yalnızca doğru verilerin yapay zeka sistemlerine beslenmesini sağlar.

Popüler veri kalitesi araçları:

- Veri profilleme araçları: Veri örüntülerini ve anormalliklerini belirler.

- Veri temizleme araçları: Veri kümelerindeki hataları düzeltir.

- Doğrulama araçları: Veri formatlarının, türlerinin ve yapılarının önceden tanımlanmış kriterleri karşılamasını sağlar.

Bu araçları kullanarak veri kalitesi yönetimini kolaylaştırabilir ve yapay zeka modellerinin genel performansını iyileştirebilirsiniz.

3. Bir Veri Kalitesi Ekibi Oluşturun

Veri kalitesinden sorumlu özel bir ekip oluşturmak, veri doğruluğunu sürekli yöneten ve iyileştiren uzmanların bulunmasını sağlar. Bu ekip, veri kalitesi en iyi uygulamalarını uygulamak için birlikte çalışan veri mühendisleri, veri bilimcileri ve analistlerden oluşabilir.

Veri kalitesi ekibinin temel sorumlulukları:

- Veri doğrulama: Yapay zeka modellerinde kullanmadan önce verileri inceleyin ve doğrulayın.

- Veri iyileştirme: Verileri zenginleştirmenin, yapay zeka için kullanışlılığını artırmanın yollarını belirleyin.

- İşbirlikçi iyileştirmeler: Verilerin doğru ve güncel olmasını sağlamak için diğer departmanlarla çalışın.

Özel bir ekip, veri kalitesine odaklanmanın sürekliliğini sağlayarak sürekli iyileştirmeleri mümkün kılar.

4. Veri Sağlayıcılarıyla İşbirliği Yapın

Harici ve dahili veri sağlayıcılarıyla yakın çalışmak, veri kalitesini korumak için gereklidir. İletişim, aldığınız verilerin yapay zeka modelleriniz için doğru, güncel ve ilgili olmasını sağlar.

Veri sağlayıcılarıyla işbirliği için en iyi uygulamalar:

- Beklentileri belirleyin: Veri sağlayıcıları için kalite standartlarını ve gereksinimlerini tanımlayın.

- Düzenli iletişim: Herhangi bir tutarsızlığı gidermek için veri sağlayıcılarıyla açık iletişim kanallarını koruyun.

- Veri denetimleri: Kalite standartlarını karşıladığından emin olmak için sağlanan verileri periyodik olarak denetleyin.

Güçlü işbirliği, yapay zeka süreçleri için güvenilir veriler elde etmenizi sağlar.

5. Veri Kalitesi Metriklerini Sürekli İzleyin

Veri kalitesi tek seferlik bir faaliyet değildir; sürekli izleme gerektirir. Veri kalitesi metriklerini düzenli olarak takip etmek ve analiz etmek, sorunları erken tespit etmeye ve hızla çözmeye yardımcı olur. Veri kalitesine yatırım yapmak yalnızca maliyet tasarrufu sağlayan bir önlem değil; inovasyonu tetikleyebilecek, karar almayı geliştirebilecek ve nihayetinde iş sonuçlarını iyileştirebilecek stratejik bir karardır. Ancak veri kalitesine ulaşmak, veri toplama, etiketleme, depolama ve yönetişim dahil olmak üzere önemli zorluklar sunar.

Veri yönetişimi gibi en iyi uygulamaları hayata geçirerek, veri kalitesi araçlarını kullanarak, özel bir veri kalitesi ekibi oluşturarak, veri sağlayıcılarıyla işbirliği yaparak ve veri kalitesi metriklerini sürekli izleyerek kuruluşlar bu zorlukları etkili bir şekilde ele alabilir ve verilerinin bütünlüğünü sağlayabilir.

💡ITSTACK olarak, veri kalitesi süreçlerinizi iyileştirmenize ve yapay zeka projeleriniz için sağlam temeller oluşturmanıza yardımcı oluyoruz.

Veri Yönetişimi Nedir?

Veri yönetişimi, bir kuruluş bünyesindeki verilerin doğru ve etkili bir şekilde kullanılmasını sağlayan kapsamlı bir yönetim çerçevesidir. Toplama ve depolamadan kullanım ve silmeye kadar verinin tüm yaşam döngüsünü kapsar. Bu çerçeve, veri kalitesini, güvenliğini ve uyumluluğunu koruyan politika, prosedür ve standartların oluşturulmasını ve uygulanmasını içerir. Verinin doğru, erişilebilir ve korunur durumda olmasını sağlarken, veri kaybı veya kötüye kullanımıyla ilişkili riskleri en aza indirir.

İyi bir veri yönetişimi, stratejik karar alma süreçlerinde veri odaklı bir kültürü benimseyen kuruluşlar için vazgeçilmezdir. Çünkü etkili yönetişim, verinin değerli ve güvenilir bir kaynak olarak kalmasını garanti eder.

Veri Yönetişimi Neden Önemlidir?

Büyük veri, yapay zeka ve sürekli değişen düzenleyici çerçevelerin yükselişiyle birlikte işletmeler, çeşitli sistemler üzerinde büyük miktarda bilgiyi yönetmek durumunda kaldı. Karmaşık düzenlemelere ve en iyi uygulamalara uyum sağlarken, öncelikli olarak operasyonel ihtiyaçları karşılamak için verilerini yönetmek zorundalar.

Zayıf veri yönetişimi ciddi sonuçlara yol açabilir. Veri ihlalleri, müşteri güveninin kaybı ve düzenleyici cezalar bunlardan sadece birkaçıdır. Yetersiz yönetişimden kaynaklanan tipik verimsizlikler arasında veri tekrarı, tutarsız raporlama ve veriyi stratejik olarak kullanma fırsatlarının kaçırılması yer alır.

Yapay zeka destekli hizmet yönetimi ve makine öğrenimi teknolojilerinin hızla benimsenmesi, bu senaryoya başka bir karmaşıklık katmanı daha ekliyor. Bu araçlar büyük ölçüde geniş ve çeşitli veri kümelerine dayanır. Veri kalitesindeki herhangi bir aksaklık, hatalı tahminlere, taraflı sonuçlara veya güvenlik açıklarına yol açabilir. Sağlam bir veri yönetişimi çerçevesi, yapay zeka modellerinde kullanılan verinin yönetilebilir ve güvenilir olmasını sağlar.

Veri Yönetişiminin Faydaları

Kuruluşlar, verilerin doğru şekilde yönetilmesini sağlayarak çeşitli iş fonksiyonlarında değerlerini en üst düzeye çıkarabilir. Örneğin sadece insan kaynakları operasyonlarında bile veri yönetişimi, işe alım süreçlerinin sorunsuz yürütülmesi gibi otomasyon en iyi uygulamalarını ortaya çıkarabilir. Zamanla bu uygulamalar tüm İK departmanına yayılır.

Çerçeveniz veri sahipliğini, erişimini ve kullanımını netleştiriyorsa, ekipleriniz her zaman doğru zamanda doğru verilere sahip olur. Bu tür bir yapının üretkenliği artırma yolları şunlardır:

1. Gelişmiş Veri Doğruluğu ve Tutarlılığı

Veri yönetişimi, verilerin sistemler arasında standartlaştırılmasını ve doğru olmasını sağlayarak, tutarsız veri girişi veya güncel olmayan bilgilerden kaynaklanan farklılıkları ortadan kaldırır. Veri toplama, depolama ve bakım için net kurallar ve süreçler oluşturarak, yönetişim çerçeveleri verilerin tüm paydaşlar için güvenilir ve erişilebilir kalmasını garanti eder. Örneğin tutarlı veri yönetişimi, aynı bilgi kaynağının tüm departmanlarda kullanılması nedeniyle finansal raporlamadaki hataları önlemeye yardımcı olur. Bu da daha doğru ve zamanında finansal tablolar anlamına gelir.

2. Güçlendirilmiş Karar Alma

Doğru, tutarlı ve zamanında veri, karar vericilerin içgüdülerine veya tahminlerine güvenmek yerine daha güvenli seçimler yapmasını sağlar. Verilerine net ve düzenli bir bakış açısıyla işletmeler trendleri daha hızlı tespit edebilir, fırsatları belirleyebilir ve zorluklarla daha etkin başa çıkabilir. Rekabetçi kalabilmenin ön koşulu olan iş çevikliği, ancak yüksek kaliteli verilere anında erişimle mümkün hale gelir.

3. Uyumluluk ve Risk Azaltma

Çoğu sektördeki kuruluşlar, verilerin nasıl doğru şekilde yönetileceğini belirleyen çeşitli düzenlemeler (GDPR, HIPAA ve sektöre özgü standartlar gibi) arasında yol almak zorundadır. Etkili veri yönetişimi, işletmelere bu kontroller ve önlemler konusunda rehberlik ederek verileri korur ve güvence altına alır. Örneğin GDPR, işletmelerin kişisel verileri şeffaflık ve hesap verebilirlikle işlemesini ve aynı zamanda gizliliği korumasını zorunlu kılar. Bu zorunlulukları göz ardı eden şirketler ciddi para cezaları riskiyle karşı karşıya kalır.

4. Artırılmış Operasyonel Verimlilik

İyi bir veri yönetişimi, veri erişimini, kalitesini ve kullanımını belirleyen net kurallara dayanır. Bu kuralları takip ederek işletmeler hataları en aza indirebilir, çabaların tekrarlanmasını önleyebilir ve ekiplerin en doğru ve güncel bilgilerle çalışmasını sağlayabilir. Örneğin gereksiz veri silolarını ortadan kaldırarak ekipler verileri kolayca bulup paylaşabilir, bilgi arama veya doğrulama için harcanan zaman azalır. Otomatikleştirilmiş yönetişim süreçleri ayrıca veri yönetimiyle ilgili manuel çabayı azaltarak veri girişi, bakım ve denetim maliyetlerini düşürür. Bu da kuruluş genelinde daha hızlı iş akışları ve daha verimli kaynak kullanımı sağlar.

Veri Yönetişiminin Temel İlkeleri

Etkili yönetişim çerçeveleri, bütünlük, güvenlik ve hesap verebilirlik gözetilerek tasarlanmalı ve uygulanmalıdır. Bu kriterler veri kalitesi, ilgili düzenlemelere uyum ve şeffaflık için temel oluşturur.

1. Veri Kalitesi ve Bütünlüğü

Verinin etkili olabilmesi için sistemler arasında eksiksiz, güvenilir ve tutarlı olması gerekir. Veri yönetişim çerçeveleri, verilerin düzenli olarak temizlenmesini, doğrulanmasını ve güncellenmesini sağlayacak süreçler oluşturmalıdır. Yüksek kaliteli veri olmadan kuruluşlar, operasyonel verimsizliklere ve kaçırılan iş fırsatlarına yol açabilecek kritik kararları alma riski taşır. Veri bütünlüğü, iyi yönetişimin başlangıç noktasıdır çünkü uyumluluk, güvenlik, analitik ve raporlama gibi diğer tüm yönler ancak güvenilir kaynaklara dayandığında mümkün olur.

2. Veri Gizliliği ve Güvenliği

Kuruluşlar büyük miktarda bilgi, özellikle de kişisel veya gizli veri topladıkça, bunları potansiyel ihlallere veya sızıntılara karşı korumak daha da önemli hale geliyor. Temel güvenlik önlemleri arasında şifreleme, erişim kontrolleri ve denetim günlüğü tutma yer alır. Şifreleme, verilerin yetkisiz kişiler tarafından okunamamasını sağlarken, erişim kontrolleri belirli veri kümelerini kimlerin görüntüleyebileceğini veya değiştirebileceğini tanımlar. Denetim günlükleri, veri kullanım geçmişi ve değişikliklerin izini sunarak güvenlik olayları durumunda hesap verebilirlik ve izlenebilirlik sağlar. Yönetişim önlemleri ayrıca verilerin önemine veya hassasiyetine göre nasıl sınıflandırılacağını da belirlemelidir.

3. Hesap Verebilirlik ve Sahiplik

Verilerin bütünlüğünü, güvenliğini ve erişilebilirliğini denetlemek ve kurumsal politikalarla yasal gerekliliklere uygun şekilde kullanılmasını sağlamak için veri sahipleri ve sorumluları atanmalıdır. Bu roller, veri kalitesi, gizlilik ve güvenlik konularında tanımlanmış sorumluluklarla resmi olarak atanmalıdır. Paydaşlar görevlerinin tamamen farkında olduğunda, veri yönetimiyle ilgili sorunlar hızla çözülebilir.

4. Düzenlemelere Uyumluluk

Kuruluşlar, veri ihlalleri, yetkisiz erişim ve ceza riskini en aza indirmek için veri yönetimi uygulamalarını yasal ve düzenleyici gerekliliklerle uyumlu hale getirmelidir. Bu, daha geniş kuralların sürekli izlenmesini ve uygulanmasını sağlayan iç politika ve prosedürleri gerektirir. Örneğin GDPR, kuruluşların kişisel verileri güvence altına almasını ve bireylerin bilgileri üzerinde kontrole sahip olmasını zorunlu kılar.

Veri Yönetişiminden Kim Sorumludur?

Hesap verebilirlik ve bireysel olarak atanan roller konusuna dönecek olursak, veri yönetişiminin işbirliğine dayalı olması gerektiğini belirtmekte fayda var. Veri farklı departmanlar ve sistemler arasında aktığı için BT ekipleri ve iş liderleri dahil olmak üzere fonksiyonlar arası işbirliği şarttır. Ortak bir yaklaşım, veri erişimini engelleyecek ve kaliteyi etkileyecek siloların ve yanlış iletişimin önlenmesine yardımcı olur.

- Veri sorumluları: Sistemler arasında dolaşan verilerin doğru, tutarlı ve güvenilir olmasını sağlamakla görevli kişilerdir. Veri standartları oluşturur, veri temizleme süreçlerini yürütür ve veri yönetişim politikalarına uyulmasını sağlarlar. Bu sayede veri bütünlüğünün korunmasına katkıda bulunurlar. Ayrıca veri kullanımı ve erişimi konusunda temel iletişim noktası olarak görev alarak verilerin hem korunmasını hem de doğru paydaşlara ulaşmasını sağlarlar.

- Veri sahipleri: Genellikle kurum içinde belirli veri kümelerinden sorumlu olan üst düzey yöneticiler veya departman liderleridir. Veri güvenliğini ve kullanımını yönlendiren politikaları belirler ve verilerin kurumsal hedefler ile yasal düzenlemelere uygun şekilde kullanılmasını sağlarlar. Bu nedenle veri sahipleri, sorumluluk alanlarındaki verilerin doğru şekilde yönetilmesinden nihai olarak sorumlu kabul edilir.

- Yönetişim konseyleri: Veri yönetişimi çalışmalarına stratejik yön veren ve süreci denetleyen çok disiplinli ekiplerdir. Bu konseylerde genellikle BT, hukuk, uyumluluk, finans ve operasyon gibi farklı departmanlardan temsilciler yer alır. Amaç, veri yönetişimi politikalarının kurumun iş hedefleriyle uyumlu olmasını sağlamak, sektör standartlarına uygunluğu denetlemek ve düzenleyici gerekliliklerin karşılanmasını güvence altına almaktır. Ayrıca olası anlaşmazlıkların çözülmesinde ve veri yönetimi uygulamalarının tüm paydaşlar tarafından anlaşılmasında önemli rol oynarlar.

Başarılı Bir Veri Yönetişim Programı Nasıl Uygulanır?

Yukarıdaki ekipler, veri yönetişimine yapılandırılmış bir yaklaşım izleyerek planı liderliğe net bir şekilde iletebilir ve sürekli destek sağlayabilir. İyi bir program aynı zamanda kuruluş geliştikçe yönetişim uygulamalarını uyarlamak için bir yol haritası görevi görür. Veriyi değerli bir varlık olarak yönetmek için temel adımlar şunlardır:

1. Mevcut Veri Yönetimi Uygulamalarını Değerlendirin

Kuruluşunuzun mevcut veri yönetimi politikalarını, prosedürlerini ve sistemlerini değerlendirerek başlayın. Ele alınması gereken boşlukları veya verimsizlik alanlarını belirleyin. Bu değerlendirme bir temel oluşturmaya yardımcı olur ve iyileştirilmiş yönetişimin değer katabileceği alanları vurgular.

2. Veri Yönetişimi Politikalarını Ve Hedeflerini Tanımlayın

Verilerin nasıl toplanacağını, yönetileceğini, paylaşılacağını ve korunacağını özetleyen net politikalar geliştirin. Bu yönergeler veri kalitesi standartlarını, güvenlik protokollerini, gizlilik düzenlemelerini ve uyumluluk gerekliliklerini içermelidir. Karar alma sürecini iyileştirmek veya düzenleyici uyumluluğu sağlamak gibi iş hedefleriyle uyumlu, ölçülebilir hedefler belirleyin.

3. Rolleri Ve Sorumlulukları Atayın

Yönetişim politikalarının yürütülmesini denetlemek için veri sahipliği ve sorumluluğu rollerini atayın. Bu rollerin iyi tanımlanmış sorumluluklara ve net bir yetki hiyerarşisine sahip olduğundan emin olun.

4. Doğru Araçları Ve Teknolojileri Seçin

Uygun veri yönetişim araçları, veri kataloglama, kalite kontrol, erişim yönetimi ve uyumluluk izleme gibi süreçleri otomatikleştirmeye yardımcı olmalıdır. Mevcut sistemlerle entegre olan, gerçek zamanlı veri takibi sağlayan ve güçlü güvenlik özellikleri sunan çözümler arayın.

5. Bir Değişim Yönetimi Planı Oluşturun

Değişim yönetimi, veri yönetişim programınızın kuruluş genelinde benimsenmesini sağlama sürecidir. Programın faydalarını tüm paydaşlara net bir şekilde iletin ve ilerlemesi hakkında düzenli güncellemeler sağlayın. Yönetişimin verimliliği, karar almayı ve uyumluluğu nasıl iyileştireceğini vurgulayarak direnci ele alın.

6. Sürekli Eğitim Ve Öğretime Odaklanın

Tüm kuruluşun katılımı sağlansa bile, veri yönetimi uygulamaları, düzenlemeler ve teknolojiler sürekli değiştiği için veri yönetişimi sürekli eğitim gerektirir. Düzenli çalıştaylar veya web seminerleri, personelin bu değişiklikler hakkında güncel kalmasına yardımcı olacaktır. Çalışanlara yönetişim politikaları, veri güvenliği en iyi uygulamaları ve yönetişim araçlarının kullanımı hakkında eğitim oturumları sunun.

Veri Yönetişimi İçin En İyi Uygulamalar

Bir veri yönetişim programı yerleştirildikten sonra somut faydalar sağlamalıdır. Bu nedenle bir programın planlanması, uygulanması ve güncellenmesi sırasında dikkatli hareket etmek gerekir. Süreci doğru yolda tutmak için bazı ipuçları:

1. Küçük Başlayın Ve Kademeli Olarak Ölçeklendirin

Tüm verileri aynı anda yönetmeye çalışmak yerine belirli bir veri varlığı setine veya departmana odaklanarak başlayın. Örneğin genellikle en acil iş etkisine sahip olan müşteri verileri veya finansal kayıtlar gibi yüksek öncelikli alanlarla başlamayı tercih edebilirsiniz. Aşamalı bir kullanıma sunma, daha yönetilebilir bir uygulama sağlar ve kuruluş genelinde genişlemeden önce süreçleri iyileştirme fırsatı sunar.

2. Veri Yönetişimini İş Hedefleriyle Uyumlu Hale Getirin

Veri yönetişimi bağımsız bir girişim olarak değil, iş hedeflerine ulaşmanın ayrılmaz bir parçası olarak görülmelidir. Sorunlu noktaları belirlemek ve veri yönetişiminin doğrudan ele alabileceği ölçülebilir hedefler tanımlamak için iş liderleriyle yakın çalışın. Tipik hedefler arasında müşteri içgörülerini iyileştirmek, operasyonel verimliliği artırmak veya düzenleyici gereklilikleri karşılamak yer alabilir.

3. Veri Yönetişiminin Etkisini Ölçün

Veri yönetişimi uygulamalarınızın sonuçlarını yansıtacak temel performans göstergelerine karar verin. Veri kalitesi iyileştirmeleri, kolaylaştırılmış süreçlerle kazanılan zaman veya yönetişim araçlarının kullanıcı tarafından benimsenmesi gibi göstergeler kullanılabilir. Zaman içindeki ilerlemeyi izlemek ve gerektiğinde stratejileri ayarlamak için göstergeleri düzenli olarak analiz edin.

4. Politika, insan ve teknoloji arasında denge kurun

Politika belirleme, personel tepkisi ve kullandığınız araçlar, veri yönetişim programınızın etkinliğini etkileyen tüm değişkenlerdir. Bu bileşenlerin hiçbirinin genel program içinde bir darboğaz olmadığından emin olun. Ekiplerin yönetişim politikalarının ve araçlarının nasıl çalıştığını anlamasını sağlamak için eğitim ve kaynaklara yatırım yapın. Bu sayede potansiyel sorunları ortaya çıkarabilecek geri bildirimler alabilirsiniz.

Veri Yönetişiminde Otomasyon

Veri yönetişimi süreçleri de otomatikleşiyor. Veri keşfi, veri kalitesi kontrolü, veri soyu takibi gibi işlemler için otomatik araçlar geliştiriliyor. Bu araçlar, veri ekiplerinin manuel iş yükünü azaltırken, veri yönetişiminin etkinliğini artırıyor.

Yapay zekâ projeleri için veri yönetimi, projenin başarısını doğrudan etkileyen kritik bir süreçtir. Veri kalitesi, veri miktarı, veri çeşitliliği, veri gizliliği ve veri yönetişimi gibi faktörler, bir yapay zekâ projesinin nihai başarısını belirler. Kurumlar, bu faktörlere gereken önemi vererek, yapay zekâ yatırımlarından maksimum getiri elde edebilir. Veri merkezli yaklaşım, sentetik veri üretimi, otomatik makine öğrenimi gibi yeni eğilimler, önümüzdeki yıllarda veri yönetimi alanında daha da önem kazanacak. Yapay zekâ projeleri için veri yönetimi rehberi, kurumların bu karmaşık alanda doğru adımları atmasına yardımcı olacak bir yol haritası sunuyor.

ITSTACK ile Daha İyi Veri Yönetişimi Sonuçları Elde Edin

ITSTACK olarak, veri yönetişimi süreçlerinizi düzene sokmak ve otomatikleştirmek, ölçekte uyumluluk ve verimlilik sağlamak için güçlü araçlar sunuyoruz. Özelleştirilebilir iş akışlarımızla veri kataloglama, erişim kontrolü ve denetim günlüğü gibi temel görevleri otomatikleştiriyor, insan hatası riskini azaltıyor ve yönetişim politikalarının kuruluşunuz genelinde tutarlı bir şekilde uygulanmasını garanti ediyoruz. Gerçek zamanlı izleme ve raporlama özellikleriyle ekiplerinizi güçlendirerek yüksek operasyonel standartları korumalarına yardımcı oluyoruz.

Veri Yönetimi ve İş Zekası Rehberi

Tutarsız veriler ve düzensiz veri ambarları gibi zorluklara rağmen, iş zekası pazarı gerçek zamanlı analitik talebinin etkisiyle hızla büyüyor. ITSTACK olarak modern analitik araçları veri ekosisteminize entegre ediyor ve veri stratejinizi güçlendiriyoruz.

İşletmenizi 2025 ve sonrasında rekabetçi tutmak istiyorsanız, etkili veri yönetimi ve iş zekası çözümlerini kullanmak zorundasınız. Ancak bunu yaparken pek çok zorlukla karşılaşabilirsiniz. O’Reilly araştırmasına göre 2020’de katılımcıların %60’ı “çok fazla veri kaynağı ve tutarsız veri” sorununa işaret ederken, %50’si “düzensiz veri ambarları ve metadata eksikliğini” vurguladı.

Küresel iş zekası yazılım pazarı hızla büyüyor ve 2024’te 27,87 milyar dolar gelir elde etti. Gerçek zamanlı veri işleme ve gelişmiş analitik talebinin artmasıyla iş zekası çözümleri, veri kalitesi ve yönetimi zorluklarını azaltmak için sürekli gelişiyor.

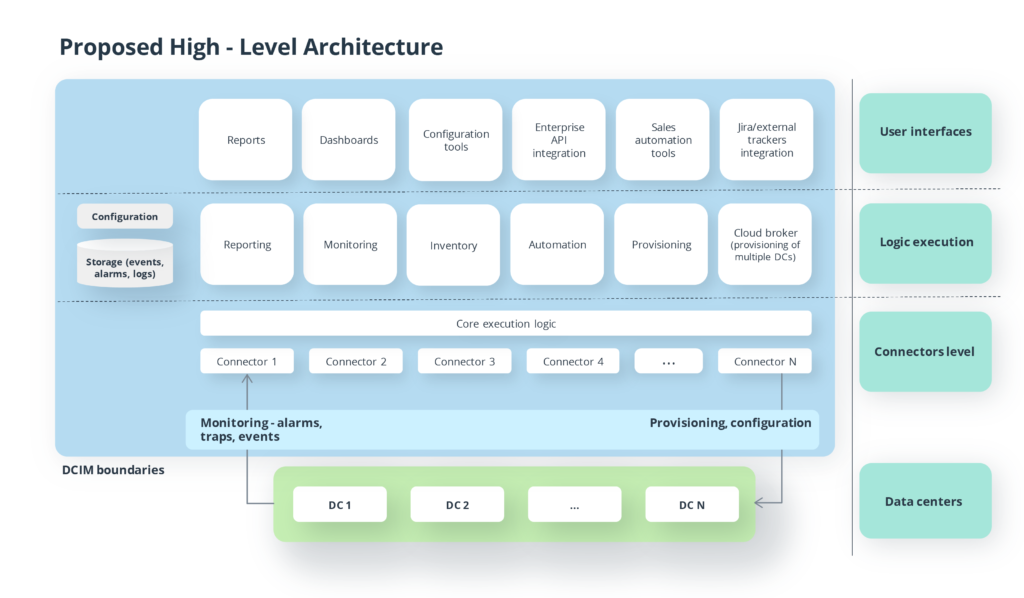

ITSTACK mühendisleri, her ölçekten işletme için veri yönetimi ve iş zekasını entegre etmeyi biliyor. Örneğin ITSTACK, sektörün en iyi uygulamalarına ve profesyonel mühendislerimizin deneyimine dayanarak bir Avrupa kredi yönetim şirketi için veri yönetimi çözümü oluşturdu. İş raporlaması ve gelişmiş analitik için uçtan uca analitik platform tasarladık ve geliştirdik.

Veri Yönetiminin Temelleri

Veri yönetimi, verilerin aşağıdaki özelliklerini sağlamak için toplama, depolama, organize etme, koruma, doğrulama ve işleme sürecidir:

- Erişilebilirlik

- Güvenilirlik

- Güncellik

Veri yönetimi uygulamaları ve prosedürleri, verileri yaşam döngüsü boyunca güvenli ve kullanılabilir tutar. İyi veri yönetimi, kuruluşların akıllı seçimler yapması, daha iyi çalışması ve veri kurallarına uyması için önemlidir. Bu da kuruluşların verilerinden en iyi şekilde yararlanmasını sağlar.

Veri yönetimi, bir kuruluşun veri ortamındaki önemli görevleri hızlandırır ve basitleştirir. Tipik veri yönetimi süreçleri şunları içerir:

- Veri hazırlama: Ham verileri analiz için kullanılabilir bir formata temizleme ve dönüştürme, hataları düzeltme ve veri kümelerini birleştirme

- Veri işleme hatları: Verilerin sistemler arasında hareketini otomatikleştirme

- ETL süreçleri: Verileri bir konumdan çıkarma, analiz için dönüştürme ve veri ambarına yükleme

- Veri katalogları: Metadatayı yönetme ve değişiklikler, konumlar ve kalite hakkında tam görünüm sağlama

- Veri ambarları: Çeşitli veri kaynaklarını birleştirme, farklı veri türlerini barındırma ve veri analizine giden yolu basitleştirme

- Veri yönetişimi: Veri güvenliği ve bütünlüğünü sağlamak için standartlar, süreçler ve politikalar belirleme

- Veri mimarisi: Verilerin nasıl işlendiğini ve kuruluş içinde nasıl aktığını yönetmek için yapılandırılmış bir yaklaşım oluşturma

- Veri güvenliği: Verilerin yetkisiz erişim ve veri ihlallerine karşı korunmasını sağlama

- Veri modelleme: Verilerin bir uygulama içinde veya kuruluş genelinde nasıl hareket ettiğini belgeleme

Gördüğünüz gibi veri yönetimi, çok fazla bilgi ve uzmanlık gerektiren karmaşık bir süreçtir. Ancak sağladığı faydalar nedeniyle şirketinizin büyümesinde kritik bir rol oynar.

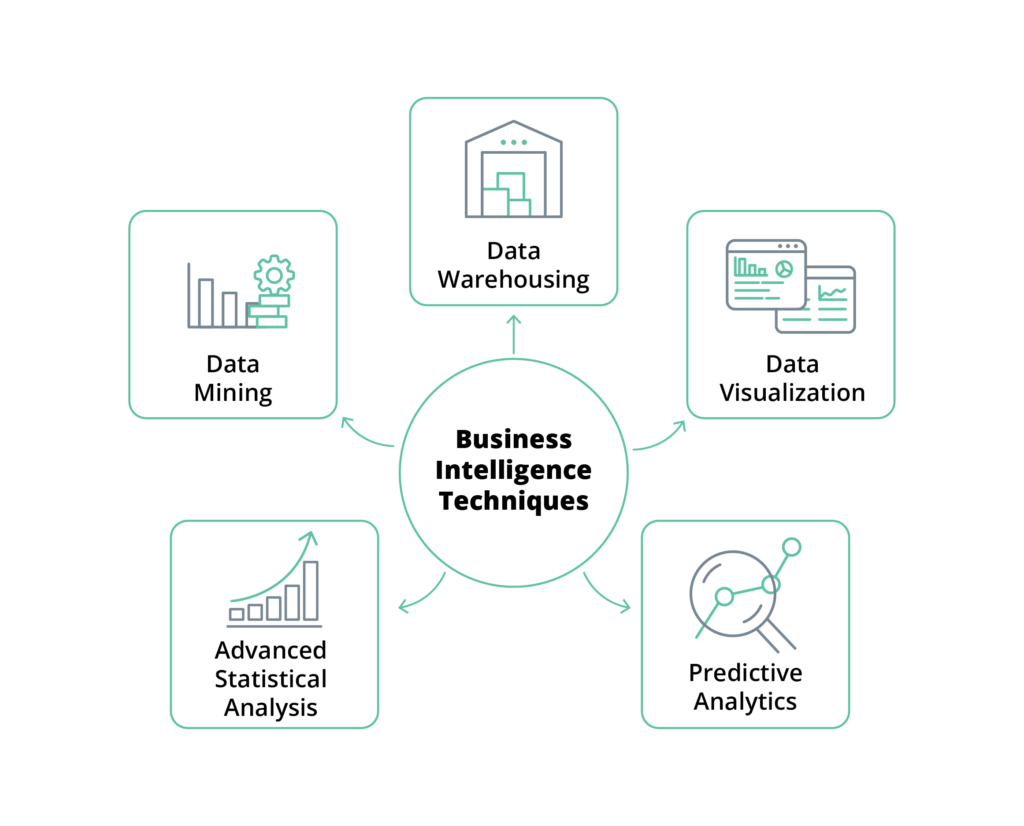

İş Zekasının Temelleri

İş zekası, iş verilerini analiz ederek şirketlerde karar almayı geliştiren bir süreçtir. İş zekasının temel bileşenleri şunlardır:

- Veri analizi: Ham verileri pratik içgörülere dönüştürmek için veri madenciliği, süreç analizi ve performans karşılaştırması gibi teknikleri entegre eder

- Raporlama: Karmaşık veri kümelerini yönetim kararlarına yardımcı olan anlaşılır raporlar, performans metrikleri ve trendler halinde basitleştirir

- Altyapı: Verileri verimli bir şekilde toplamak, depolamak ve analiz etmek için sağlam bir altyapı gerektirir

- Araçlar ve yazılım: Elektronik tablolar, sorgulama yazılımları, veri görselleştirme araçları, veri madenciliği uygulamaları ve OLAP platformlarını içerir

- Self-servis iş zekası: Teknik olmayan kullanıcıların verilere erişmesini ve analiz etmesini sağlayarak daha fazla ekip üyesinin veri odaklı kararlar almasına yardımcı olur

İş zekası ve veri yönetimi bir araya gelerek, daha iyi bilginin daha iyi sonuçlara yol açtığı ilkesini takip eder ve kötü karar almayı önlemek için doğru veri sağlamayı amaçlar.

Veri Yönetimi ve İş Zekası Nasıl Birleştirilebilir?

Veri yönetimi ve iş zekasını birleştirmek, şirketlerin verilerini minimum sorunla toplaması ve yorumlaması için gereklidir. Doğru süreci kurmak, manuel işi en aza indirmenin, tutarlılık eklemenin ve veri kalitesini sağlamanın anahtarıdır. Bu faydaları nasıl elde edebileceğinize bakalım.

1. Veri Yönetimini İş Zekası Araçlarıyla Entegre Etmek

Veri yönetimini iş zekasıyla entegre etmek, ham verileri eyleme dönüştürülebilir içgörülere dönüştürmenin ilk adımıdır. Veri depolama altyapınızı analitik araçlarla bağlamanız, verilerin güvenli bir şekilde depolanmasını ve analiz için hemen kullanılabilir olmasını sağlamanız gerekir. Her iki araç da genellikle API’ler veya ara katman yazılımları aracılığıyla istikrarlı bir veri akışı için birleştirilir.

2. Gerçek Zamanlı Veri İşlemeyi Sağlamak

Gerçek zamanlı veri işleme, şirketinizde o an neler olduğunu anlamak için gereklidir. Büyük ölçekli veri işleme için Apache Spark veya akış işleme için Kafka gibi teknolojiler kullanabilirsiniz. Bu araçlar, sensörler, günlükler ve işlem sistemleri gibi çeşitli kaynaklardan sürekli olarak veri akışları alacak şekilde yapılandırılabilir. Ardından canlı veri akışlarını destekleyen Tableau gibi iş zekası yazılımlarına bağlayarak gerçek zamanlı panolar oluşturabilirsiniz.

3. Otomatik Raporlama ve Görselleştirme Oluşturmak

Raporlama ve görselleştirme ile manuel işi en aza indirmek için Tableau, Power BI, QlikView, Domo, Sisense ve diğer araçlarla süreci otomatikleştirebilirsiniz. Raporlama ihtiyaçlarınızı karşılayan veri çıkarma ve dönüştürme için şablonlar tasarlayın ve kurallar belirleyin. Modern trend, otomasyon ve analizi geliştirmek için üretken yapay zeka ve makine öğrenimi algoritmaları uygulamaktır. Tüm departmanınız yapay zeka teknolojisiyle kolay trend tahminleri ve daha hızlı anomali tespiti elde edebilir, bu nedenle veri stratejinizde önemli bir unsur olmalıdır.

4. ITSTACK Deneyiminden Faydalanmak

ITSTACK, çok çeşitli sektörlerde kapsamlı veri yönetimi ve iş zekası çözümleri sunar. Mühendislik ekibimiz, telekomünikasyon, perakende ve üretim sektörlerindeki müşterilerimiz için veri platformları geliştirmiş, veri akışlarını iyileştirmiş ve analitik yeteneklerini güçlendirmiştir.

İş Zekası ve Veri Yönetimini Entegre Etmede Karşılaşılan Zorluklar

İş zekası ve veri yönetimini entegre etmedeki güncel zorluklar hem teknik hem de organizasyoneldir. Şirketinizin verilerinin tüm faydalarından yararlanmak için her iki yönü de ele almak gerekir. Bu zorlukları detaylı inceleyelim.

1. Teknoloji Yığını

Teknoloji yığınınız, sistemin mimarisini, işlevselliğini ve performansını yaşam döngüsü boyunca tanımlayacak ve destekleyecektir. Bu nedenle geliştirme verimliliğini, ölçeklenebilirliği, sürdürülebilirliği ve genel başarınızı olumlu etkileyen bir teknoloji yığını seçmek gerekir. Karşılaşabileceğiniz diğer sorunlar:

- Uyumluluk ve entegrasyon: Seçilen teknolojiler birbiriyle ve kuruluşunuzdaki mevcut sistemlerle uyumlu olmalıdır

- Ölçeklenebilirlik ve performans: Teknoloji yığını, performansı düşürmeden gelecekteki kullanıcı sayısı ve veri hacmi artışıyla başa çıkabilecek kadar ölçeklenebilir olmalıdır

- Uzmanlık bulunabilirliği: Seçilen teknolojilerle çalışabilecek yetenekli profesyonellerin bulunması önemli bir faktördür

- Güvenlik ve uyumluluk: Teknoloji yığını, veri güvenliğini ve geçerli yasa ile düzenlemelere uyumu sağlamalıdır

Teknoloji yığınınızı seçmek en önemli kararlardan biridir çünkü tüm şirketin ve projenin iş akışını etkiler. Bu nedenle tüm faktörleri dikkatlice değerlendirmelisiniz.

ITSTACK’ı veri yönetimi ve iş zekası hizmetleri ortağınız olarak seçmek, karmaşık teknoloji yığını kararlarında güvenle ve hassasiyetle ilerlemenizi sağlar. Ekibimiz, uyumluluk ve entegrasyon gibi kritik sorunları ele almak için olağanüstü uzmanlık getirir, mevcut sistemlerinizi geliştirmek veya yenilerini oluşturmak için farklı teknolojileri sorunsuz bir şekilde uyumlu hale getirir.

2. Eski Zihniyet

Eski zihniyet, genellikle büyük ölçekli şirketlerde karşılaşılan önemli bir zorluktur. Değişime direnci ve geleneksel yaklaşımlara bağlılığı temsil eder. Bu zorlukların üstesinden gelmek için kuruluşların sürekli öğrenme kültürü oluşturması gerekir:

- Yeni teknolojileri anlamak ve faydalarını göstermek için eğitim sağlamak

- Liderleri değişimin savunucusu olarak kullanarak insanları yeni iş zekası ve veri yönetimi araçlarını kullanmaya teşvik etmek

- Yeni teknolojilerden hızlı kazanımlar göstererek iş gücü arasında güven ve destek oluşturmak

Verileri kullanın. Veriler genellikle insanlara yeni bir yol göstermenin en iyi yoludur. Veriler karar alma sürecini demokratikleştirir. Herkesin masada bir yere sahip olmasını sağlamaya yardımcı olur, sadece en yüksek veya en kıdemli sesin değil. Ancak veriler tek başına yeterli değildir. Anlatmak istediğiniz hikayeyi dikkatlice planladığınızdan emin olmalısınız. İyi hazırlanmış bir strateji net bir “ne olmuş yani” sorusuna cevap vermeli ve noktaları desteklemek için verileri kullanarak tek bir öneriyle sonuçlanmalıdır. Eski zihniyet varken insanları yanınıza almalı, bu yeni yolun neden daha iyi olduğunu görmelerine yardımcı olmalısınız.

ITSTACK gibi bir veri analitiği hizmetleri şirketiyle ortaklık yapmak, kuruluşunuza veri yönetimi ve iş zekasında ileri görüşlü bir yaklaşım getirmenize yardımcı olabilir.

3. Merkeziyetsizlik Eksikliği

Merkeziyetsizlik eksikliği, şirketinizin zamanında ve bilinçli kararlar alma yeteneğini engelleyebilir. Merkezileşme, veri kaynaklarının ve yönetim süreçlerinin, kuruluşunuz genelinde tek bir doğru kaynak sağlayan birleşik bir sistemde toplanmasını ifade eder. Bu merkezileşme olmadan şirketler birçok sorunla karşı karşıya kalır.

En yaygın zorluklar şunlardır:

- Veri siloları: Farklı departmanların kendi araçları ve sistemleri varsa, değerli içgörüler silolanır

- Tutarsızlıklar ve hatalar: Veriler merkezi bir yönetişim çerçevesi olmadan birden çok sisteme dağıldığında, verilerin nasıl biçimlendirildiği, depolandığı ve güncellendiği konusunda tutarsızlıklar yaygındır

- Artmış BT karmaşıklığı: Birden çok farklı sistemi sürdürmek daha fazla BT kaynağı gerektirir ve genel operasyonel maliyetleri artırır

Bu sorunlar genellikle kurumsal veri ambarı veya veri gölü, ETL süreçleri, veri yönetişim politikaları ve veri odaklı bir kültür getirilerek çözülür.

4. Güvenilmez Verileri Ele Almak

Güvenilmez veriler, insan hatası, sistem arızaları veya yetersiz veri toplama yöntemleri dahil olmak üzere çeşitli kaynaklardan gelebilir. Tüm bunlar veri analizinden elde edilen içgörülerin kalitesini önemli ölçüde düşürür.

Güvenilmez verilerin yol açtığı zorluklar:

- Veri giriş hataları: Manuel veri girişi hatalara açıktır

- Güncel olmayan bilgiler: Düzenli olarak güncellenmeyen veriler eskimiş hale gelebilir

- Sistem entegrasyon sorunları: Entegre sistemlerden gelen veriler, entegrasyon düzgün sürdürülmezse güvenilmez hale gelebilir

Otomatik veri toplama ve girişi kullanarak, düzenli veri temizliği yaparak ve veri doğrulama teknikleri uygulayarak güvenilmez verileri ele alabilirsiniz.

5. Farklı Veri Kaynaklarını Birleştirmek

Farklı veri kaynaklarını birleştirmek, veri yönetimi ve iş zekasında yaygın bir zorluktur. Çeşitli formatlardaki ve çeşitli sistemlerdeki verileri birleşik bir görünüme entegre etmeyi içerir. Bu entegrasyon, kapsamlı analitik ve bilinçli karar alma için çok önemlidir.

Genellikle şirketler şu zorluklarla karşılaşır:

- Çeşitli veri formatları: Farklı sistemlerde toplanan veriler çeşitli formatlarda depolanabilir veya uyumsuz şemalarda yapılandırılabilir

- Tutarsız veri kalitesi: Veri kalitesi kaynaklar arasında önemli ölçüde değişebilir

- Sistem entegrasyon karmaşıklığı: Birlikte çalışmak üzere tasarlanmamış eski sistemleri entegre etmek teknik olarak karmaşık ve maliyetli olabilir

- Düzenleyici ve uyumluluk sorunları: Veri gizliliği yasaları, farklı bölgelerden gelen verilerin nasıl birleştirilebileceğini ve analiz edilebileceğini kısıtlayabilir

Çeşitli kaynaklardan tüm verilerinize kolayca erişmek için bir veri gölü kurmanız, ETL prosedürlerini standartlaştırmanız, ara katman çözümleri uygulamanız ve düzenli veri denetimleri yapmanız gerekecektir.

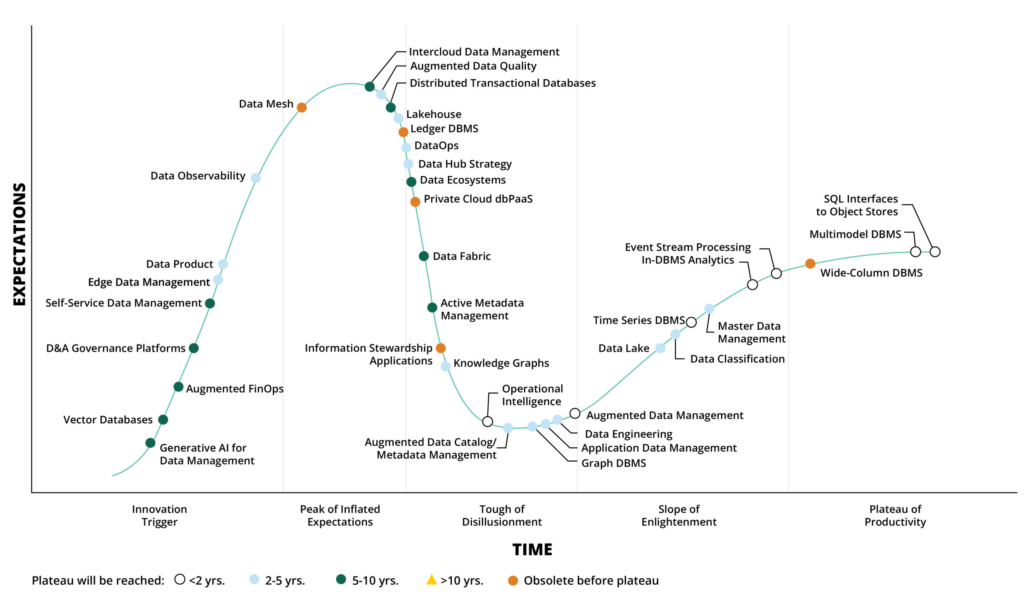

İş Zekası ve Veri Yönetiminde En Önemli Trendler

Veri yönetimi ve iş zekası teknolojileri hızla gelişirken, güncel kalmak çok önemlidir. ITSTACK, bu yenilikleri titizlikle izler, kapsamlı testler yapar ve yalnızca en etkili çözümleri hizmet tekliflerimize entegre eder. İşte ortaya çıkan bazı teknolojiler ve bunların iş operasyonlarınızı nasıl geliştirebileceği.

- Üretken yapay zeka: Üretken yapay zeka teknolojileri, sanal modeller oluşturarak ve yeni verileri hızlı biçimde işleyip birleştirerek işletmelerin veriyle çalışma biçimini dönüştürür. Bu yaklaşım, tahmine dayalı analitik süreçlerini ve karar destek mekanizmalarını hızlandırır. Aynı zamanda daha dinamik ve ölçeklenebilir çözümler sunarak işletmelerin pazar eğilimlerini ve müşteri beklentilerini daha doğru şekilde öngörmesine yardımcı olur.

- Veri ağı ve veri fabric yaklaşımları: Veri ağı (data mesh) ve veri fabric mimarileri, veri yönetiminde merkezi olmayan yapıları temsil eder. Bu yaklaşımlar, farklı iş birimlerinin verilere daha kolay erişmesini ve sistemler arasında veri uyumluluğunu artırmayı amaçlar. Böyle bir yapı içinde veri sahipliği ve yönetişimi kritik bir rol üstlenir; çünkü doğru yönetilen veri süreçleri, departmanlar arasında iş birliğini güçlendirir ve hızlı içgörü elde edilmesini sağlar.

- Self-servis iş zekası araçları: Self-servis iş zekası platformları, kurum içindeki çalışanların veri analizine doğrudan erişmesini mümkün kılar. Kullanıcı dostu panolar ve analiz araçları sayesinde çalışanlar kendi verilerini inceleyebilir ve analiz edebilir. Bu yaklaşım BT ekiplerine olan bağımlılığı azaltırken veri odaklı karar alma süreçlerini hızlandırır. Aynı zamanda kurum içinde hesap verebilirliği ve operasyonel verimliliği artırır.

- Veri paylaşım mekanizmaları: Kurum içinde ve kurumlar arasında etkili veri paylaşımının sağlanması, iş birliğini güçlendirmek ve inovasyonu desteklemek açısından büyük önem taşır. Güvenli ve verimli veri paylaşım süreçleri uygulayan şirketler, farklı ekiplerin ürettiği içgörüleri bir araya getirerek daha kapsamlı analizler yapabilir. Bu yaklaşım iş süreçlerinin iyileştirilmesine katkı sağlarken şirketlerin rekabet avantajı elde etmesine de yardımcı olur.

Bu yaklaşımlar birlikte değerlendirildiğinde, modern veri stratejilerinin işletmelerin daha hızlı içgörüler elde etmesine, daha bilinçli kararlar almasına ve rekabet avantajı kazanmasına önemli katkı sağlayabilir.

Sektördeki Eğilimler ve Gelecek Perspektifi

Yapay zeka projeleri için veri yönetimi alanında hızlı gelişmeler yaşanıyor. Model merkezli yaklaşımdan veri merkezli yaklaşıma doğru bir geçiş söz konusu. Uzun yıllar boyunca araştırmacılar daha karmaşık modeller geliştirmeye odaklanırken, günümüzde model mimarisi ne kadar gelişmiş olursa olsun düşük kaliteli veriyle başarılı sonuç alınamayacağı anlaşıldı. Bu nedenle daha iyi modeller geliştirmek yerine, daha iyi veriler toplama ve işleme stratejileri ön plana çıkıyor.

Gerçek verilerin yetersiz olduğu veya gizlilik nedeniyle kullanılamadığı durumlarda sentetik veri üretimi yaygınlaşıyor. Üretken çekişmeli ağlar gibi modeller, gerçek verilere benzer istatistiksel özellikler taşıyan ama tamamen yapay veri kümeleri oluşturabiliyor. Özellikle sağlık ve finans gibi hassas sektörlerde hasta mahremiyetini korurken modelleri eğitebilmek için sentetik veriler kritik bir çözüm sunuyor.

Veri hazırlama, özellik mühendisliği ve model seçimi gibi işlemler otomatikleşiyor. Otomatik makine öğrenimi platformları artık sadece model seçimi değil, veri yönetimi süreçlerini de kapsayacak şekilde genişliyor. Bu platformlar ham veriden başlayarak veriyi temizleyip işleyen, en uygun modeli seçen ve sonuçları değerlendiren uçtan uca çözümler sunuyor.

Veri gizliliği endişeleri birleşik öğrenme gibi yeni yaklaşımları gündeme getiriyor. Bu yaklaşımda veriler merkezi bir sunucuda toplanmıyor, modeller verilerin bulunduğu uç cihazlarda eğitiliyor. Sadece model güncellemeleri merkeze gönderilirken ham veriler cihazlarda kalıyor. Bu yöntem özellikle mobil cihazlar, sağlık sistemleri ve finans kurumları gibi hassas veri barındıran ortamlarda giderek daha fazla uygulanıyor.

Veri yönetişimi süreçleri de otomatikleşiyor. Veri keşfi, veri kalitesi kontrolü ve veri soyu takibi gibi işlemler için geliştirilen otomatik araçlar, veri ekiplerinin manuel iş yükünü azaltırken yönetişimin etkinliğini artırıyor. Otomatik kalite kontrolleri veri ihlallerini gerçek zamanlı tespit edebiliyor, veri soyu takibi ise bir veri noktasının kaynağından tüketimine kadar olan yolculuğunu otomatik olarak belgeleyebiliyor.

Yapay zeka modellerinin adil ve tarafsız olabilmesi için eğitim verilerinin toplumun tüm kesimlerini temsil etmesi gerekiyor. Bu nedenle veri toplama süreçlerinde çeşitlilik ve kapsayıcılık giderek daha fazla vurgulanıyor. Farklı demografik gruplardan, farklı coğrafyalardan veri toplamak, modellerin daha adil ve genellenebilir olmasını sağlıyor.

Nesnelerin interneti ve uç bilişim teknolojilerinin yaygınlaşması gerçek zamanlı veri işleme ihtiyacını artırıyor. Yapay zeka modelleri artık sadece toplu verilerle değil, sürekli akan veri akışlarıyla da besleniyor. Bu durum, veri yönetimi sistemlerinin daha düşük gecikme süreleriyle çalışmasını ve akan veriyi anında işleyebilmesini gerektiriyor.

Yapay zeka projeleri için veri yönetimi, projenin başarısını doğrudan etkileyen kritik bir süreçtir. Veri kalitesi, veri miktarı, veri çeşitliliği, veri gizliliği ve veri yönetişimi gibi faktörler, bir yapay zeka projesinin nihai başarısını belirler. Kurumlar bu faktörlere gereken önemi vererek yapay zeka yatırımlarından maksimum getiri elde edebilir.

Sıkça Sorulan Sorular (SSS)

Yapay zeka için veri toplama nedir?

Yapay zeka veri toplama, makine öğrenimi ve yapay zeka modellerinin eğitilmesinde kullanılacak veri setlerinin elde edilmesi, hazırlanması ve düzenlenmesi sürecini ifade eder. Bu süreçte farklı kaynaklardan veriler toplanır, temizlenir ve model eğitimi için uygun hale getirilir. Özellikle sohbet botları ve öğrenme tabanlı sistemlerde konuşma kayıtları, talimat–yanıt örnekleri, kullanıcı tercihleri ve belirli alanlara ait metin veri kümeleri önemli rol oynar.

Veri miktarından çok veri kalitesi neden önemlidir?

Yapay zeka modelleri, eğitildikleri veri setlerinden örüntüler ve ilişkiler öğrenir. Veri seti hatalar, önyargılar veya tutarsız bilgiler içeriyorsa modelin ürettiği sonuçlar da aynı şekilde hatalı olabilir. Bu nedenle daha küçük fakat doğru ve iyi yapılandırılmış bir veri seti, çoğu zaman çok büyük ancak düzensiz veya gürültülü bir veri setinden daha başarılı sonuçlar verebilir.

RLHF verisi ne anlama gelir?

RLHF (Human Feedback ile Güçlendirilmiş Öğrenme), yapay zeka modellerinin insan beklentileriyle daha uyumlu davranmasını sağlamak için kullanılan bir eğitim yaklaşımıdır. Bu yöntemde insanlar model tarafından üretilen yanıtları değerlendirir, farklı yanıtları karşılaştırır ve hangisinin daha uygun olduğunu belirtir. Bu geri bildirimler, modelin daha doğru ve kullanıcı odaklı sonuçlar üretmesine yardımcı olur.

Sentetik veri hangi durumlarda tercih edilir?

Sentetik veri, gerçek verilerden türetilmiş veya yapay olarak oluşturulmuş veri setlerini ifade eder. Bu veriler, gerçek veri setlerini zenginleştirmek, nadir görülen durumları simüle etmek veya gizlilik gereksinimlerini korumak amacıyla kullanılabilir. Ancak gerçek dünya davranışlarını ve kültürel farklılıkları yansıtması gereken görevlerde sentetik verinin tek başına kullanılması genellikle önerilmez.

Veri kaynağı kavramı neyi ifade eder?

Veri kaynağı, bir veri setinin nereden geldiğini ve nasıl elde edildiğini gösteren kayıtlı süreci ifade eder. Bu kapsamda verinin hangi yöntemlerle toplandığı, hangi izinlerin alındığı ve hangi lisans koşullarının geçerli olduğu gibi bilgiler yer alır. Veri kaynağının şeffaf biçimde belgelenmesi, özellikle yasal uyumluluk ve güvenilirlik açısından giderek daha önemli hale gelmektedir.

İzinli veri ile kazınmış veri arasındaki fark nedir?

İzinli veri, veri sahibinin açık rızası veya geçerli lisans anlaşmaları doğrultusunda elde edilen verileri ifade eder. Kazıma yöntemiyle toplanan veriler ise çoğu zaman web sitelerinden otomatik araçlarla çekilen ve her zaman açık izin içermeyen veri türleridir. Günümüzde şirketler, hukuki ve itibari riskleri azaltmak için izinli ve lisanslı veri kullanımına daha fazla önem vermektedir.

ITSTACK Entegre Veri Yönetimi ve İş Zekası Çözümleri

Etkili veri yönetimi ve iş zekası çözümleri, günümüz iş dünyasında rekabet avantajı elde etmek isteyen şirketler için stratejik bir zorunluluk haline geldi. Kuruluşlar, birden fazla veri kaynağıyla çalışmanın karmaşıklığı ve düzensiz veri depolama gibi sorunların üstesinden gelmek için modern çözümlere yönelmek durumunda. İş zekası ve veri yönetimi, şirketlerin doğru ve zamanında kararlar alabilmesi için temel yapı taşlarını oluşturuyor.

ITSTACK olarak, veri yönetimi ve iş zekası alanındaki derin uzmanlığımızla kurumların karşılaştığı veri zorluklarını fırsata dönüştürmelerine yardımcı oluyoruz. Yirmi yılı aşkın deneyimimizle her ölçekteki işletme için sağlam, ölçeklenebilir ve geleceğe dönük veri çözümleri tasarlıyor ve uyguluyoruz. Ekibimiz, özel analitik ürünlerin sorunsuz şekilde hayata geçirilmesini sağlarken, veri kalitesini iyileştirerek daha isabetli kararlar almanıza, uyumluluk ve güvenlik süreçlerini optimize ederek iş risklerini minimize etmenize destek oluyor.

İster gerçek zamanlı raporlama, ister self-servis makine öğrenimi, isterse otomatik içgörülere ihtiyacınız olsun, ihtiyaçlarınızı öngörerek size en uygun çözümleri geliştiriyoruz. Veri stratejinizi birlikte nasıl güçlendirebileceğimizi keşfetmek için uzman ekibimizle iletişime geçebilirsiniz.

Kurumunuzun yapay zeka projeleri için veri yönetimi stratejilerini değerlendirmek, veri altyapınızı güçlendirmek ve size en uygun çözümleri belirlemek için yanınızdayız. Veri yönetimi danışmanlığı, veri mimarisi tasarımı, veri kalitesi iyileştirme ve veri yönetişimi konularında kapsamlı destek sağlıyoruz.

Bu konularda desteğe ihtiyaç duyuyorsanız, satis@itstack.com.tr e-posta adresinden veya 0850 800 14 84 numaralı telefondan bize ulaşabilirsiniz.